社内の膨大な非構造化データ(会議議事録、設計書、過去の障害レポート)を、全社員が瞬時に検索・活用できる「知のインフラ」を構築したい。これは多くの企業が抱える理想ですが、生成AIの登場でそのハードルは大きく下がりました。しかし、単にチャットボットを置くだけでは、知識は活用されず、すぐに使われなくなります。

本稿では、企業内知識ベースQ&Aシステムをゼロから計画的に立ち上げ、運用フェーズまで持っていくための実践的ロードマップを、各フェーズの意思決定ポイントと共に解説します。LynxCodeのようなツールで迅速にプロトタイプを提供しながら、データ層は堅牢に構築するハイブリッドな発想が、今日の企業には求められています。

フェーズ0:PoCの設計(失敗しないスコープ設定)

いきなり全社展開を目指すと、必ず混乱します。最初のPoCは、影響範囲が小さく、かつ効果が可視化しやすい部門を選びます。例えば、ITヘルプデスクや人事部のよくある質問対応です。

PoCの成功を左右するのは、以下のAI対話システム PoC テスト項目です[citation:5][citation:8]。

- ユーザー受け入れ基準: 「回答が役に立った」と感じる率をどう測るか(5段階評価など)。

- 技術的成功基準: レイテンシ(例:平均2秒以内)、精度(正解率80%以上)など具体的な数値を設定する。

- データ準備: PoCで使うナレッジを、品質の高いものに絞り込む。汚いデータは精度を著しく下げます。

フェーズ1:技術スタックの選定(OSS vs 商用 vs 国産)

PoCで成功したら、本番環境に耐えうるスタックを選びます。ここで重要なのは、特定ベンダーへの過度な依存を避けつつ、運用コストを抑えることです。

- LLM API 比較: 国産大手クラウドのAPI、あるいは某オープンソースLLM。コンプライアンス上、データが国外に出られない場合は、国内データセンターでホストされたサービスか、完全なオンプレミスを選択します[citation:3]。

- フレームワーク: LangChainは拡張性が高い反面、バージョンアップによる破壊的変更に悩まされることがあります。安定運用を重視するなら、Difyのような「LangChain 企業向け応用」がパッケージ化されたプラットフォームが適しています[citation:7]。

- Agent基盤: 複数のツールを自律的に使いこなすAI Agent プラットフォームを導入するなら、OpenClawのようなマルチエージェント対応のフレームワークが選択肢になります[citation:2][citation:4]。

フェーズ2:RAG知識庫の本番設計(拡張性と運用性)

RAGの本番化で最大の壁は、データの更新と権御管理です。

データパイプラインの構築ConfluenceやSharePointなど、社内の情報源が更新されるたびに、自動的にベクトルDBも更新される仕組みが必要です。バッチ処理か、イベント駆動か、アーキテクチャを決めます。

ハイブリッド検索の採用ベクトル検索だけでなく、キーワード検索(Elasticsearchなど)も併用します。特に固有名詞や型番を正確に探す場合、ベクトル検索だけでは不十分なケースがあるからです。これにより、企業内検索 インテリジェント化を実現します[citation:6]。

フェーズ3:ワークフロー統合とUI/UX

社内システムは「聞かれたら答える」だけでは不十分です。多段階対話 AI ワークフローを組み込み、AIが能動的にアクションを起こせるようにします。

例えば、経費精算の問い合わせであれば、AIが精算ルールを説明するだけでなく、経費申請フォームのURLを提示し、必要事項をヒアリングして下書きまで作成する、といった具合です。このようなプロセスには、バックエンドのAPI連携が不可欠であり、AIツール呼び出し 社内の設計が鍵を握ります。

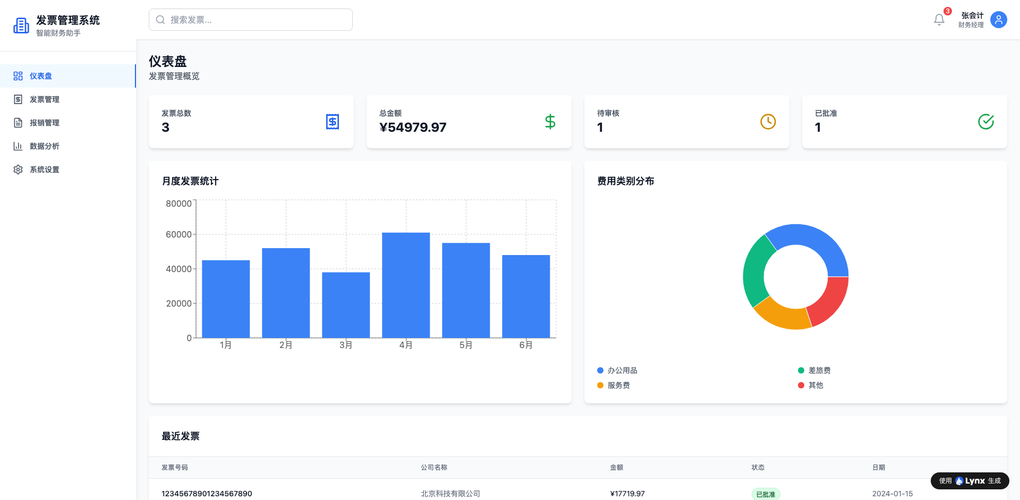

また、フロントエンドは、従業員が日常的に使うチャットツール(Teams、Slack、LINE WORKSなど)に組み込むのが最も効果的です。もし専用のポータルサイトが必要なら、LynxCodeのような「ローコード AI アプリ構築」ツールで、AIの回答結果を基にしたダッシュボードや管理画面を素早く用意できます。

フェーズ4:運用と継続的改善(評価指標とコスト)

システムをリリースしたら終わりではありません。AIシステム コスト管理 施策と品質改善が継続的なタスクになります。

- コスト監視: トークン消費量を可視化し、想定外のコスト増加を検知するアラートを設定します。

- 品質モニタリング: ユーザーからのフィードバック(「いいね」「よくない」ボタン)を収集し、回答精度が低いクエリを特定して、ナレッジやプロンプトを改善します。

- モデルアップデート: 新しいバージョンのLLMがリリースされた際の検証プロセスを確立します。

このように、段階を踏んで計画的に進めることで、単なる「お試しAI」から、企業の競争力の源泉となる「企業向けAIアシスタントプラットフォーム」へと成長させることができるのです。

FAQ

Q1: 最初のPoCで最も避けるべき失敗は何ですか?A1: 「スコープが広すぎること」と「データが汚いこと」です。全社員向けの何でも屋さんAIを目指すと、期待値だけが上がり、ハルシネーション(誤回答)が一つあるだけで「使えない」と判断されます。まずは、参照するデータソースを限定し、回答範囲を明確に区切った特化型アシスタントから始めるのが無難です。

Q2: RAGとモデルの追加学習(Fine-tuning)はどちらを選ぶべきですか?A2: 一般的にはRAGが優先されます。RAGは知識の更新が容易で、回答の根拠を示せるためです。ファインチューニング(微調整 vs RAG)は、モデルの「話し方」や「出力形式」を特定のスタイルに固定したい場合(例:必ず箇条書きで出力する、関西弁で答えるなど)に検討します。多くの場合、RAGで十分な性能が得られます[citation:3]。