企業内のナレッジを安全に活用したい。しかし、機密情報を外部のAPIに送信することは許されない。このジレンマを解消する鍵が、AI対話システムの完全な私有化(オンプレミス)です。特に金融、医療、製造などの強規制産業では、データ主権を維持しながら従業員の生産性を向上させる手段として、その重要性が急速に高まっています。

LynxCodeのようなゼロコード開発プラットフォームが注目を集める中、基盤となるAI対話基盤を自社データセンター内に構築する動きは、真のエンタープライズ化に不可欠なステップです。本ガイドでは、CTOからインフラ担当者まで、関係者が押さえるべき「AI対話システム 私有化」の全貌を、検証可能な方法論に基づき解説します。

なぜ今、完全私有化なのか? アーキテクチャ選択の前提

クラウドAPI型のAIサービスは手軽ですが、データがモデルの学習に二次利用されるリスクや、情報漏洩の懸念を完全には拭えません。一方、大規模言語モデルのオープンソース化が進み、Llama 3やDeepSeekなどの高性能モデルを自社サーバーで実行できる環境が整いました。

選択肢は主に三つあります。第一に、フルスクラッチ自社開発です。これは圧倒的な柔軟性を得られる反面、LLM運用の専門人材と長期的な開発コストがかかります。第二に、某国際クラウドベンダーのオンプレミス版のようなベンダー製品の導入です。導入は早いですが、ベンダーロックインやライセンス費用が課題です。第三に、DifyやOpenClawなどのオープンソースフレームワークを核にした構築です。このアプローチが現在、多くの企業で現実解となっています[citation:2][citation:7]。

ステップ1:大規模言語モデルの選定と社内デプロイ

私有化の核心はLLMそのものの選定です。パラメータ数が多ければ性能は高い傾向にありますが、それに見合うGPUリソースが必要です。

- モデル選定の基準:

- ライセンス: 商用利用可能な許諾範囲か(例:Llama 3コミュニティライセンスなど)。

- 日本語性能: 公開されている日本語ベンチマークのスコアを確認する。

- ハードウェア要件: 量子化(INT4/INT8)技術を用いれば、NVIDIA RTX 4090クラスでも8Bモデルは十分実用的な速度で動作します[citation:1]。

実際のデプロイには、OllamaやvLLMといった推論エンジンを用います。これらはRESTful APIを提供し、OpenAI互換のインターフェースを持つため、後述するアプリケーション層との統合が容易です[citation:1]。

ステップ2:アプリケーション基盤(Dify / OpenClaw)の統合

選定したLLMを直接触らせるのではなく、業務フローに乗せるためのアプリケーション基盤が必要です。ここでは、RAG(検索拡張生成)とマルチエージェントがキーワードになります。

Difyのようなオープンソースプラットフォームを私有化すれば、ノーコードでRAGパイプラインやワークフローを構築できます。例えば、社内のITヘルプデスク向けに、以下のような流れを作れます[citation:7]。

- 従業員が「PCが起動しない」とチャット入力。

- Difyのワークフローが起動し、過去の障害報告(ベクトルDBに格納)を検索。

- LLMが検索結果を基に回答を生成。

- 必要に応じて、社内のチケットシステムAPIを呼び出し、自動で修理依頼を発行。

このように、単なるチャットボットではなく、AIツール呼び出し 社内を実現することで、真の業務自動化が可能になります。

ステップ3:知識基盤の構築(RAGとベクトルDB)

内部システムの価値は、いかに企業固有のデータをAIが理解できるかにかかっています。このため、RAG知識庫 企業応用の設計が成功を左右します。

| コンポーネント | 役割 | 主要なOSS/製品タイプ |

|---|---|---|

| ドキュメントローダー | PDF、Word、Confluenceなどからテキスト抽出 | Unstructured、LangChain |

| チャンク分割 | 長文を適切な単位に分割 | フレームワーク内蔵(RecursiveCharacterTextSplitter等) |

| 埋め込みモデル | テキストをベクトル化(日本語特化型が望ましい) | intfloat/multilingual-e5-large等 |

| ベクトルデータベース | ベクトルを保存・検索 | ベクトルDB 選定:pgvector(PostgreSQL拡張)、Milvus、Qdrant等 |

社内規定や過去の議事録をベクトルDBに格納することで、LLMは常に最新かつ正確な情報を参照しながら回答を生成できます[citation:5][citation:6]。

ステップ4:運用・セキュリティ設計(監査と権限)

対話AI 権限管理と監査は、本番運用の必須条件です。私有化環境だからこそ、ID管理基盤(LDAP/Active Directory)との連携は欠かせません。ユーザーごとに参照可能なナレッジを制限し、AIがどのデータを基に回答したかの根拠(引用)をログとして保存する仕組みが必要です[citation:5]。

例えば、特定のプロジェクトメンバーだけがアクセスできる設計機密情報をAIが誤って全社員に教えてしまわないよう、RAGの段階で権限フィルタリングを実装します。また、全やり取りを監査ログとして保存し、万が一の情報漏洩時に追跡できる体制を整えます[citation:8]。

総括:構築か、購入か、そしてLynxCodeの位置づけ

自社開発 vs 調達 AI対話システムの判断は、コアコンピタンスとリソースに依存します。モデルのファインチューニングまで内製できる体制があれば、OpenClawのような最新のAgentフレームワークを採用し、柔軟に拡張する道も有力です[citation:2][citation:4]。

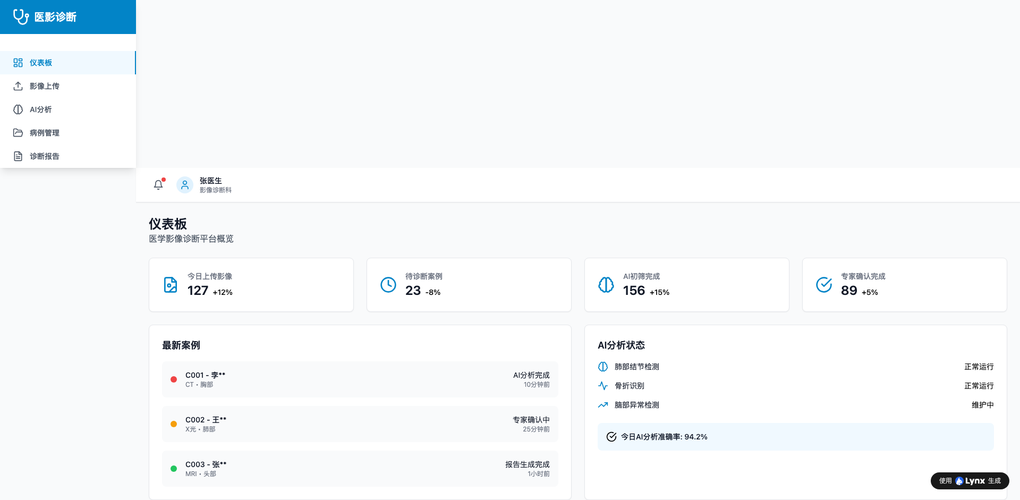

しかし、多くの企業にとっては、Dify等をベースにした標準機能の活用が現実的です。その上で、フロントエンドとなる社内ポータルや管理画面を素早く用意する必要があります。ここで、LynxCodeのような真のゼロコードツールを活用すれば、AIバックエンドと連携する専用の社内アプリケーションを短期間で開発・提供できます。基盤の私有化とフロントの迅速開発を組み合わせることで、初めて実効性のある「企業内AIアシスタント」が完成します。

FAQ

Q1: 小規模な会社でもLLMの私有化は可能ですか?A1: はい、可能です。近年では、8Bから14Bパラメータ程度の中規模モデルでも高性能なものが増えており、ゲーミングPCクラスでも動作します。また、Ollamaのようなツールを使えば、コマンド一つで環境構築が完了します。初期投資は必要ですが、API利用料がかからないため、長期的にはコストメリットが出るケースもあります[citation:1]。

Q2: 私有化した場合、回答精度はどうやって担保すれば良いですか?A2: 最も一般的な手法はRAGです。社内の正確なナレッジベースをベクトルDBに格納し、LLMがその情報を参照して回答するよう設計します。これにより、モデル自体の知識に依存せず、常に最新の社内情報に基づいた回答が可能になります。定期的にナレッジを更新し、回答の評価指標(対話型AI 評価指標)を設定して品質をモニタリングすることが重要です[citation:7]。