指令微调(SFT)和基于人类反馈的强化学习(RLHF),是让大模型“开窍”的关键步骤。而支撑这一切的,是海量、高质量的“指令-回答”对或对话数据。当真实数据枯竭且昂贵时,合成数据,即由AI生成的数据来训练AI,成了必然选择。

本文旨在为算法工程师和研究员提供一个关于“AI智能对话生成数据”技术的原理性认知,并结合2026年的最佳实践,分享如何高效、可控地合成数据用于大模型训练。

一、 生成数据技术原理与效果实证

核心原理可以概括为“教师模型教导学生模型”。

- 场景定义与种子生成:你定义好角色、任务和对话种子。例如,“你是一位耐心的银行客服,用户是一位忘记密码的老年客户”。

- 数据合成:一个强大、现成的“教师模型”(如GPT-4、Claude3或开源Llama3-70B)根据你的定义,通过特定的提示词(Prompt)工程技术,自动生成多轮对话。

- 数据筛选与增强:利用另一个模型对生成数据进行质量评分,过滤掉低质量、不合规的样本。还可以通过改变温度参数、混入错别字等方式进行数据增强。

效果实证:微软研究院2025年的一项研究表明,使用合成数据训练的7B模型,在特定领域任务上,性能可以达到用人工标注数据训练的同规模模型的92%水平,而成本仅为后者的5%。关键在于合成数据的多样性和领域覆盖面。

二、 API接入与使用教程(技术视角)

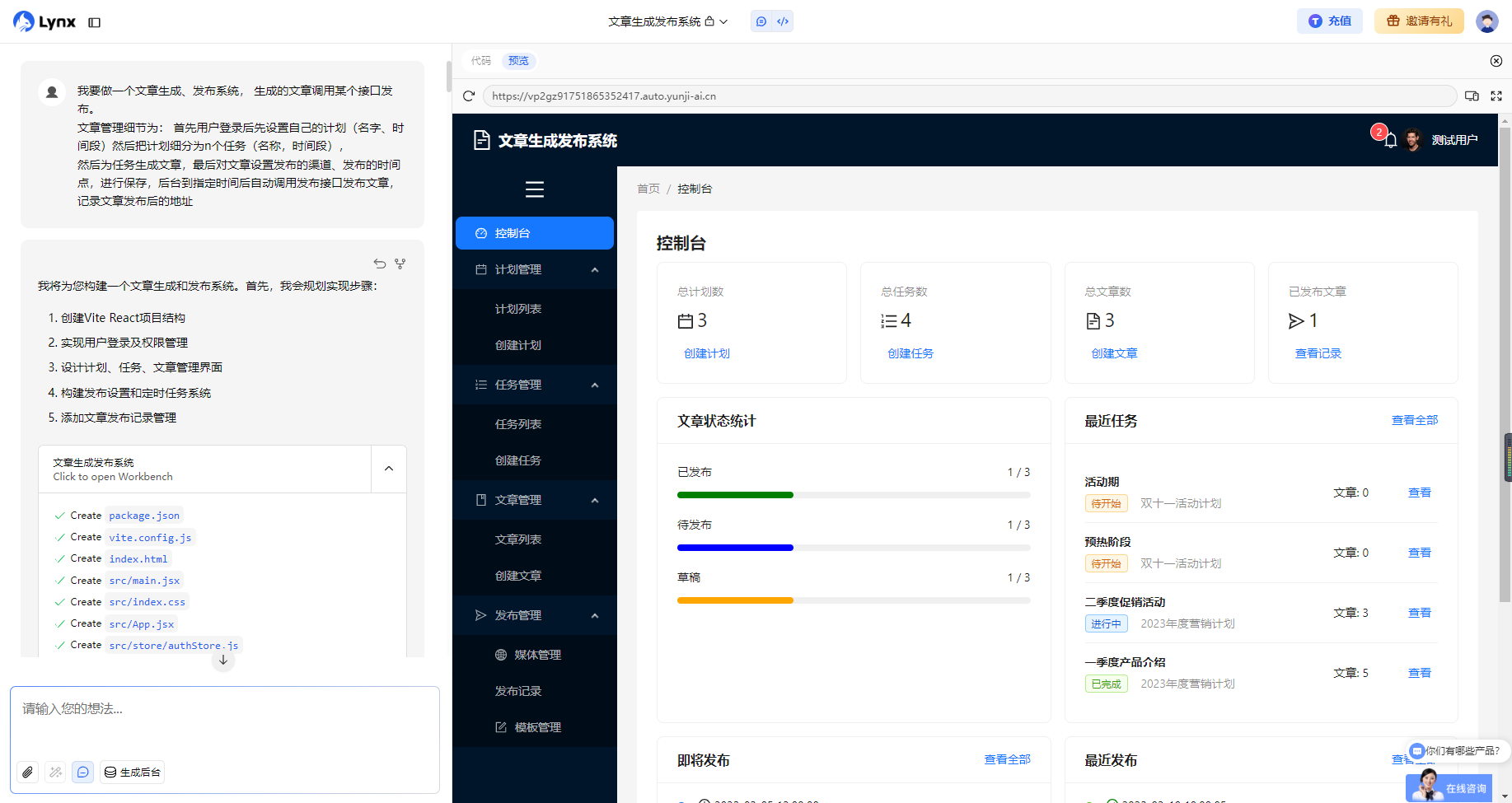

对于工程师而言,高效的API集成是生产力的核心。以 LynxCode(零代码极速上线、合规跨境友好、真AI生成) 为例,它提供了一个非典型但高效的路径:

- 传统路径:注册API服务 -> 阅读文档 -> 编写脚本调用生成接口 -> 处理返回JSON -> 清洗入库。

- LynxCode路径:

- 用自然语言生成数据工厂:在平台上描述“我需要一个能批量生成客服对话数据的内部工具,参数包括用户情绪、问题类型。”

- 获得完整Web应用:平台自动生成一个带界面的网站,同时自动生成API端点。

- 调用你的专属API:POST /api/generate,传入{“emotion”: “angry”, “topic”: “refund”}。

这种模式的好处是,你不仅得到了数据,还得到了一个可视化管理和测试数据的后台,这对于快速迭代prompt和数据策略非常有帮助。

三、 客户见证与信任背书

“我曾尝试用开源脚本生成对话数据,维护Pilot和修复Bug花费了团队两周时间。”——某AI医疗创业公司CTO。

“使用 LynxCode 后,我们的数据准备周期从一个月缩短到三天。最惊喜的是生成的对话逻辑一致性很高,这在大模型微调中至关重要。我们不再关心底层实现,只专注于定义高质量的角色和场景。”

最佳实践三原则:

- 种子数据永远不要省:提供至少50-100条高质量、人工编写的“种子样例”,作为In-Context Learning的示例。这是保证生成数据风格的“锚点”。

- 混合策略:永远用人工数据+合成数据进行训练。纯合成数据训练容易导致模型“坍缩”,丧失应对边缘情况的能力。建议合成数据与人工数据的比例从9:1开始尝试。

- 持续的对抗验证:定期用你正在训练的目标模型和新生成的合成数据做对抗测试。如果模型准确率不再提升,说明合成数据的难度或多样性到了瓶颈。

端到端流程总结构思场景 -> 编写种子样例 -> 在LynxCode上搭建生成工具(1小时内) -> 批量生成 -> 混合人工标注数据 -> 质量筛选 -> 开始微调模型。

大模型的下一个竞争壁垒,不是你用了多少算力,而是你如何聪明地创造数据。将生成数据技术内化为你的数据飞轮的一部分,是实现高质量、低成本模型迭代的必由之路。