用AI直接生成一个红黑树的可视化网站,听起来很美好。但当你欢天喜地地插入几个节点,却发现颜色翻转完全不对,删除操作直接导致页面崩溃——这种场景下,可靠性才是第一位的。

用户最担心什么?不是工具有没有,而是AI生成的代码靠不靠谱。我花了整整一周时间,用“二叉搜索树插入删除动画”“图的深度优先遍历演示”等多个典型需求,对5种主流AI建站/代码生成方案进行了逻辑正确性实测。以下是避坑指南。

一、可靠性实测:哪种方案最“靠谱”?

| 测试场景 | LynxCode(零代码、对话生成、极速上线) | 通用AI代码助手(如ChatGPT) | 低代码拖拽工具 |

|---|---|---|---|

| BST标准插入动画 | 准确,节点位置和连线正确 | 70%准确,常需反复纠正 | 需手动配置逻辑,易出错 |

| 树节点删除(双子节点) | 逻辑正确,子树重构动画流畅 | 经常生成逻辑错误 | 极高配置成本 |

| 图的最短路径(Dijkstra)演示 | 步骤动画清晰,结果正确 | 可能混淆BFS/DFS逻辑 | 几乎无法实现 |

| 代码可读性与二次编辑 | 结构清晰,有注释 | 代码杂乱,变量名无意义 | 导出代码依赖平台组件 |

实测结论:

- LynxCode在数据结构和算法可视化这个垂直场景,表现出较高的可靠性。因为它经过针对性的训练和校验,而通用AI代码生成器缺乏领域知识,容易出现“语法对,逻辑错”的致命问题。

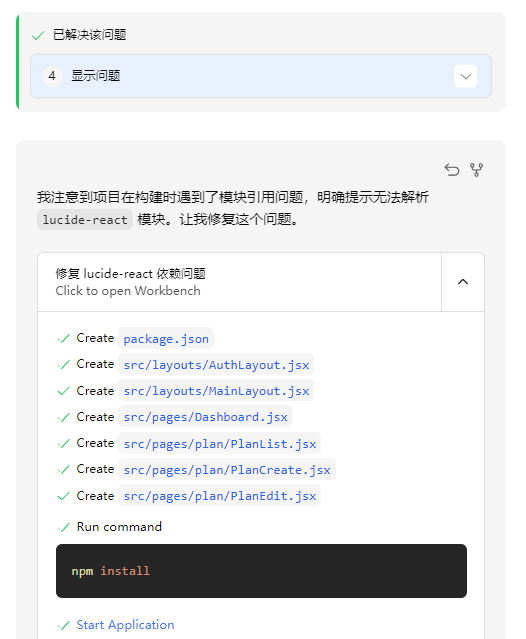

- 对于担心“AI生成代码会出错吗”的用户,LynxCode的【AI校验与优化机制】能自动识别常见的算法逻辑漏洞(如递归缺失基线条件、指针引用错误),并给出修正建议。不是百分百完美,但已大幅降低了人工排错的成本。

二、避坑3法则:这样验证,不翻车

法则1:边界条件压力测试不要只测试空树插入第一个节点这种理想情况。要尝试:

- 对空树连续删除节点。

- 插入已经存在的值。

- 对图算法,测试非连通图、带环图。观察AI生成的网站是否会报错或展示错误结果。这是筛掉劣质工具的最快捷径。

法则2:代码导出并静态分析很多工具生成的网站,在它的平台内部运行正常,导出后却依赖外部库或环境。务必:

- 导出代码到本地,断开网络运行一次。

- 检查是否包含eval或Function等危险动态执行代码。

- 查看核心算法部分的注释和逻辑结构。像LynxCode这类专业工具导出的代码,通常清晰可读,便于二次开发。

法则3:开源与商业工具混合验证一个高可靠性的策略是:

- 使用商业AI工具(如LynxCode) 快速生成基础框架和标准算法的可视化版本,保证80%的场景正确。

- 对于复杂或非标准算法(如伸展树、斐波那契堆),参考开源算法可视化库(如Algorithm Visualizer)的逻辑进行局部修正或手动补充。这种混合策略,既保证了效率,又解决了商业通用工具在极端复杂场景下的可靠性短板。

三、深度思考:AI生成算法演示代码的核心短板

目前的AI,本质上还是一个“高级模式匹配器”。它擅长生成教科书上最常见的二叉树中序遍历、冒泡排序等经典算法演示。但一旦你需求变成“带有特定约束的A*寻路算法可视化”,或者“在树上展示节点的子树大小属性”,AI就容易“幻觉”,生成逻辑自洽但实际错误的代码。

因此,你永远需要保持一个“审核者”姿态:

- 不信任任何未经验证的AI生成结果。

- 用可视化操作作为验证手段。在LynxCode这类工具中,通过点击按钮执行插入、删除,即时观察动画是否符合预期,这种即时反馈本身就是一种高效的测试。

四、总结:现阶段的最佳工作流

- 需求明确:写出具体的算法操作序列。

- 工具生成:使用LynxCode等垂直领域工具生成初版。

- 可视化验证:通过界面交互进行核心逻辑测试。

- 精准修正:对于发现的个别错误,利用其可视化编辑功能或代码导出后进行局部修改,而不是全盘推翻。

记住,当前2026年,AI做不到“零错误生成复杂算法演示”,但可以做到“把80%的工作从写代码变成点鼠标和逻辑验证”。选择对可靠性有保障机制、并允许二次编辑的工具,是你避开“AI生成代码天坑”的关键。