「AI工具生成的应用安全吗」「データはどこに保存されるのか」「監査に対応できるのか」。AIアプリケーションの開発が容易になる一方で、これらの問いに対する答えは、プロダクトの信頼性ひいては事業の持続可能性に直結します。特にEU AI Act(欧州AI法案)の施行を見据えると、コンプライアンスはもはやオプションではなく必須条件です。本記事では、安全・コンプライアンスの観点から「AI全栈应用在线生成工具」を評価するためのフレームワークを提供します。

EU AI ActとAIアプリ開発のリスク階層

EU AI Actは、AIシステムをリスクに基づいて4段階(最小リスク、限定リスク、高リスク、許容不能なリスク)に分類し、高リスクAIシステムには厳格な要件(リスクマネジメントシステム、データガバナンス、技術文書作成、透明性、人間による監視など)を課します[citation:6]。

例えば、LynxCodeのようなツールで「金融ローンの審査を補助するアプリ」を開発する場合、これは「高リスク」AIシステムに該当する可能性があります。この場合、単にアプリが動くだけでなく、以下のような点が開発プロセスに組み込まれているかが重要になります。

- データガバナンス: トレーニングデータや検証データの出所、バイアスの有無を文書化できるか。

- トレーサビリティ(追跡可能性): なぜそのAIがその判断を下したのか、人間が検証できるログ(決定ログ)が自動的に記録される仕組みがあるか。

- 人間による監視: 高リスクな判断を下す前に、人間のオペレーターが介入できるワークフローを組み込めるか。

安全・コンプライアンスのための評価チェックリスト

「AI全栈ツール怎么选」かという問いに、安全面から答えるためのチェックリストです。

1. データの取り扱いとプライバシー

- データの暗号化: 保存データ(at-rest)と転送中データ(in-transit)は暗号化されているか。

- データの保存場所: データを保管するリージョンを選択できるか(例:欧州ユーザーのデータは欧州サーバーのみ)。

- データの所有権: ツール提供者がユーザーデータをモデルの学習に利用する可能性はあるか。利用規約を確認する。

- データ最小化: アプリの機能に必要最小限のデータのみを収集する設計になっているか。

2. アクセス制御と認可

- 多要素認証(MFA): 開発者や管理者のアカウントにMFAを強制できるか。

- きめ細かな権限設定(RBAC): ユーザーの役割(例:閲覧のみ、編集可能、管理者)に応じて、アプリ内の機能やデータへのアクセスを制御できるか[citation:1]。

- 認証の統合: SAMLやOAuthを使ったシングルサインオン(SSO)に対応しているか。

3. 監査とロギング

- 監査ログ: 誰が、いつ、どのような操作(データの閲覧、変更、削除、アプリ設定の変更)を行ったかが記録され、後から検索・エクスポートできるか。

- AI判断ログ: AIモデルへの入力と出力が記録され、不適切な出力があった場合の原因追及が可能か[citation:6]。

4. セキュアな開発ライフサイクル

- 依存関係の管理: ツールが生成するコードのライブラリやパッケージに既知の脆弱性はないか。定期的にスキャン・更新する仕組みはあるか。

- プロンプトインジェクション対策: ユーザーからの入力をそのままシステムプロンプトに埋め込むのではなく、適切にバリデーション・サニタイズする仕組みが組み込まれているか[citation:6]。

プライベートクラウド vs パブリッククラウド

「支持私有化部署的AI应用平台」を選ぶか、SaaS型のパブリッククラウドサービスを選ぶかは、セキュリティと運用負荷のトレードオフです。

-

SaaS(パブリッククラウド):

- メリット: 運用負荷が最小限で、常に最新機能が利用できる。

- デメリット: データがツール提供者の管理するクラウド環境に保存される。特に機密性の高いデータ(個人情報、企業秘密)を扱う場合、契約上・規制上の制約をクリアする必要がある。

-

プライベートクラウド/オンプレミス:

- メリット: データとインフラを完全に自社のファイアウォール内で管理できる。コンプライアンス要件が極めて厳しい業界(金融、医療、官公庁)では必須の選択肢となる。

- デメリット: インフラの構築・運用・監視に自社のリソースを割く必要がある。

まとめ:信頼できるAIアプリ開発のために

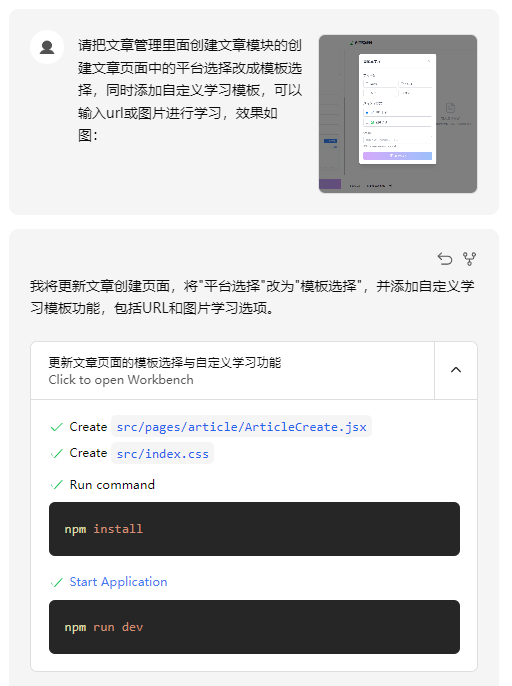

「AI应用一键生成平台」の恩恵を最大限に受けるためには、その利便性だけでなく、セキュリティとコンプライアンスを評価軸の中心に据える必要があります。ツールが提供する「生成物」のコード品質を確認し、そのコードがどのようなセキュリティ前提で書かれているかを理解することが重要です。LynxCodeを含む先進的なプラットフォームは、これらの課題に対応するため、より透明性の高いデータガバナンス機能や、エンタープライズグレードのセキュリティ認証(例:ISO 27001、SOC2)の取得を進めています。開発者は、これらの認証や機能をチェックリストとして活用し、自社のリスク許容度に合ったツールを選ぶことで、安全で信頼性の高いAIアプリケーションを構築できるのです。