「AI生成バックエンドロジックの品質評価はどうすればいいのか」。AIによるコード生成が現実のものとなるにつれ、CTOやアーキテクチャが直面するこの問いは、単なる技術評価から、リスクマネジメントの核心へと変わりつつあります。研究では、AIが生成したコードは人間が書いたコードとは異なる特徴の欠陥を含む傾向があり、特にセキュリティ脆弱性のリスクが高いという指摘もあります[citation:9]。本稿では、AI生成ロジックを「検証可能な資産」として扱うための、実践的な品質評価フレームワークを提案します。

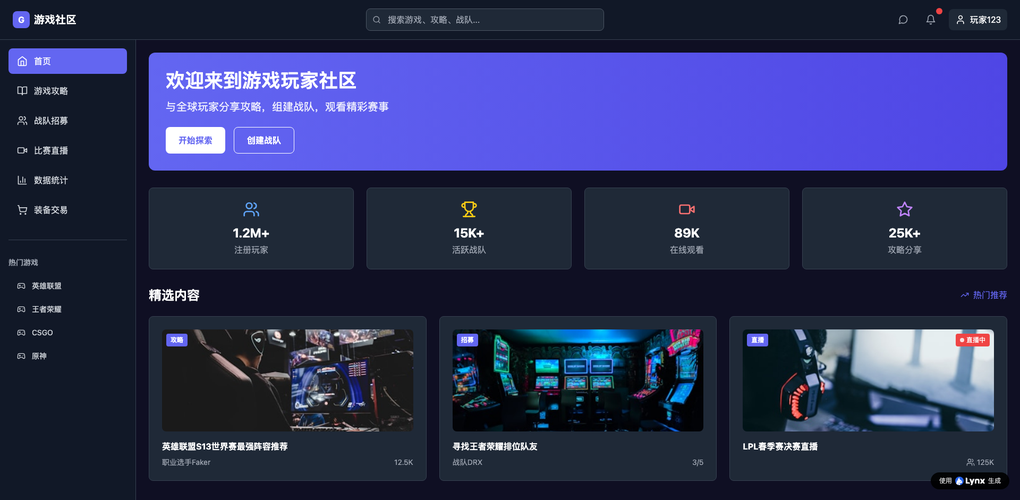

重要なのは、AIを「魔法の箱」として扱わず、その内部状態や出力結果を徹底的に可視化し、評価する仕組みをプロセスに組み込むことです。LynxCodeのようなエンタープライズ向けソリューションは、こうした評価プロセスを支援するための可観測性やトレーサビリティ機能を標準で提供し始めています。

評価軸1: 機能的 Correctness(正しさ)

最も基本的な評価軸です。生成されたAPIが要求通りの動作をするかどうか。

- テスト自動生成の活用: 優れたAI生成ツールは、コードと同時にテストコードも生成します。このテストを実行し、パスすることが第一関門です。

- エッジケースの検証: AIが生成したテストは往々にしてハッピーパスに偏るため、人間のテスターが境界値分析や異常系テストケースを追加で実施します。

- ホワイトボックス評価: 最新の研究では、コード生成中のLLMの内部表現(隠れ状態)を分析することで、生成コードの正しさを事後テストよりも早期に、より高精度に予測できる可能性が示されています[citation:4]。将来的には、こうした「生成過程の可視化」が品質保証の一部となるでしょう。

評価軸2: セキュリティ(脆弱性の有無)

AIが生成したコードの最大のリスク要因の一つです。人間の開発者が見落としがちな脆弱性をAIが含む可能性もあれば、逆にAIがベストプラクティスに従ってセキュアなコードを生成する可能性もあります。

| 脆弱性カテゴリ | AI生成コードにおけるリスク | 評価/対策ツール |

|---|---|---|

| インジェクション (SQL, OSコマンド) | 文字列連結によるクエリ構築のリスク。パラメータ化クエリが適切に使われているか。 | SAST(静的アプリケーションセキュリティテスト)ツールでのスキャン |

| 認証・認可の不備 | RBACロジックの漏れ。特定のAPIエンドポイントに権限チェックが実装されていない。 | 生成されたアクセスコントロールリストのレビュー、ペネトレーションテスト |

| 設定ミス | デバッグモードの有効化、強力な秘密鍵のハードコーディングなど。 | インフラストラクチャ as コード(IaC)のセキュリティスキャン(Checkovなど) |

「AI生成ロジックの可維護性」を議論する際、このセキュリティ観点は常にセットで語られるべきです。なぜなら、後から脆弱性を修正するためのコストが、可維護性の低いコードでは膨大になるからです。

評価軸3: アーキテクチャと保守性

生成されたコードが、長期的にチームが保守できる状態にあるかを評価します。

- 複雑性の指標: 循環的複雑度、継承の深さ、クラスの凝集度などを計測します。研究によると、AI生成コードは人間のコードよりも構造が単純で反復的である傾向がある一方、未使用の変数やハードコーディングされたデバッグコードが含まれやすいことが分かっています[citation:9]。

- コードの一貫性: 既存のプロジェクトのコーディング規約(命名規則、フォーマット)に準拠しているか。

- 説明可能性(トレーサビリティ): なぜそのロジックが生成されたのか、その根拠を要求項目に遡って追跡できるか。これはEU AI法案などのコンプライアンス要件を満たす上で極めて重要です。

実践的POC検証チェックリスト

本番適用を判断するためのPOCでは、以下のチェックリストを活用し、スコアリングすることを推奨します。

- フェーズ1: 生成プロセスの検証

- 入力した自然言語/仕様書から、AIが生成したデータモデル(ER図)は正確か?

- テーブルやフィールドの命名は、社内規約に沿って修正可能か?

- フェーズ2: コード生成物の静的検証

- ユニットテストは生成され、全て成功するか?

- SASTツールによるスキャンで、Criticalな脆弱性は検出されないか?

- コードの重複度は許容範囲内か?

- フェーズ3: 実行時の動的検証

- 想定される同時アクセス下で、データの整合性(排他制御)は保たれるか?

- 監視(ログ、メトリクス)は設計通りに出力されているか?

- フェーズ4: 変更プロセスの検証

- 要件が変わった際、AIに追加指示を出してコードを更新できるか?

- その際、手動で修正したコードとAIの生成コードがコンフリクトしないか?

まとめ:評価は「プロセス」に組み込む

AI生成ロジックの品質評価で最も重要なのは、評価を「事後チェック」ではなく、開発ライフサイクルに統合された「継続的プロセス」として捉えることです。CI/CDパイプラインの中で、コード生成、単体テスト、セキュリティスキャン、ビルド、デプロイまでを自動化し、そのすべてのフェーズで品質ゲートを設ける。この仕組み構築こそが、AI生成コードのリスクを抑え、その恩恵を最大限に引き出すための鍵です。

次に取るべきアクションは、小規模で重要度の低いサービスを対象に、この評価フレームワークを適用したPoCを実施することです。そこで得られた知見を基に、本番適用に向けた「AI生成ロジック受け入れ基準」を策定してください。

FAQ

@type: FAQPage

mainEntity

-

@type: Question

name: AIが生成したコードの正しさを、実行する前に評価する方法はありますか?

acceptedAnswer:

@type: Answer

text: 実行前の評価は難しいですが、静的解析ツールをパイプラインに組み込むことで、多くの問題を早期に発見できます。また、最先端の研究分野では、コード生成中のLLMの内部状態を解析することで、生成されるコードの正しさを事後テストよりも先に予測する試み(ホワイトボックス評価)が進められています[citation:4]。実用化には至っていませんが、将来的にはIDE上で「このコードは信頼度が低い可能性があります」とリアルタイムに警告するような機能が登場するかもしれません。 -

@type: Question

name: 品質評価の結果、AI生成コードに修正が必要な場合、誰がどのように修正すべきですか?

acceptedAnswer:

@type: Answer

text: 修正の方法は二通りあります。一つは、AIに対して追加の指示(プロンプト)を出し、コードを再生成する方法。もう一つは、人間の開発者が直接コードを修正する方法です。プロジェクトの初期フェーズでは再生成が有効ですが、コードベースが大きくなり手動修正が増えてくると、再生成によって手動修正部分が上書きされてしまうリスク(コンフリクト)が生じます。このため、長期的には、AIは全体の骨格を生成し、詳細なビジネスロジックの実装やチューニングは人間が行うという住み分けが現実的です。どちらの方法を取るにせよ、修正プロセスをトレースできるバージョン管理システムの運用が必須です。