AIが生成するコードの品質は、プロンプト次第で大きく変わる――これは多くの開発者が実感していることだろう。しかし、チームでAI開発を進めるにあたり、個人の力量に頼らない「仕組み化された品質保証」が不可欠である。本稿では、AI自動生成フロントエンドとバックエンドのコードを、いかにして「プロダクションレディ」な状態に引き上げ、長期的に保守していくか、その具体的な方法論を解説する。

AI生成コードの品質を左右する3つの要因

AIコード生成ツールの出力品質は、主に以下の要素で決まる。

- 入力情報の質:曖昧な要件ほど、AIは「それらしい」コードを生成するが、実際の要求とはズレが生じやすい。

- ツールの特性:ある種類のAIプラットフォームはコードの美しさに定評があり、別の種類のツールは生成スピードに特化している。

- 事後処理の徹底:生成されたコードに対して、人間がどのような検証と修正を加えるか。

特に3番目の「事後処理」が、長期的なプロジェクトの成否を分ける。

ハーネスエンジニアリング:AIの暴走を防ぐ構造的アプローチ

AIが生成したコードの品質ばらつきを人の注意力だけでカバーするのは限界がある。そこで注目されているのが「ハーネスエンジニアリング」という考え方である。これは、AIの出力を「手綱(ハーネス)」で制御し、逸脱を検知・修正する仕組みをコードベース自体に組み込むアプローチだ。

この考え方を具現化するには、以下の4段階のエスカレーションラダーを構築する。

L1: ドキュメントによるルール定義

まず、チームのコーディング規約やアーキテクチャ原則を、AIが解釈可能な形式でドキュメント化する。単なる文章ではなく、YAMLフロントマターなどを用いて機械可読なメタデータ(適用レベル、対象ファイルなど)を付与することで、後続の自動チェックの基盤とする。

L2: AIレビューによるセマンティックチェック

ドキュメント化されたルールを、コードレビュー時にAIアシスタントに参照させる。例えば、プルリクエスト作成時にClaude CodeなどのAIレビューアが差分をチェックし、「このAPIレスポンスには、エラー時の次のアクションが含まれていません」といった、定量化しづらいが重要な品質基準を指摘する。

L3: CIツールによる機械的検証

リンティングやフォーマット、アーキテクチャ境界の違反など、機械的に判定できるルールはCI/CDパイプラインで自動的にブロックする。具体的には以下のツールを組み合わせる。

- Biome / ESLint:コードスタイル、潜在的なバグの検出

- dependency-cruiser:アーキテクチャ上の依存関係ルール(例:「プレゼンテーション層はデータ層に直接依存しない」)の違反検出

- knip:未使用コードの検出

- jscpd:コード重複の検出

重要なのは、即時修正が必要な「blocking」と、情報提供にとどめる「advisory」を明確に区別することである。これにより、開発者が重要な警告を見逃すリスクを減らせる。

L4: 構造テストによる不変条件の固定

最も強力なレベルが、アーキテクチャテストである。例えば、VitestやJestを用いて「ファイル名は必ずケバブケースであること」「全てのZodスキーマに.strict()が適用されていること」などをテストコードとして記述する。これにより、ルールは「読むもの」から「破るとCIが落ちるもの」へと昇格する。

| レベル | 執行手段 | 対象ルールの例 | 違反時の扱い |

|---|---|---|---|

| L1 | ドキュメント | 命名規則の考え方、アーキテクチャの方針 | 参考情報 |

| L2 | AIレビュー | エラーハンドリングの網羅性、ユーザービリティ | PRコメント |

| L3 | CIツール | インデント、未使用変数、循環依存 | ブロッキング/アドバイザリ |

| L4 | 構造テスト | 特定のライブラリの使用禁止、スキーマ定義の厳格性 | テスト失敗(マージ不可) |

生成コードのテスト戦略:単体テストからE2Eまで

AIが生成したコードであっても、テスト戦略の基本は変わらない。むしろ、生成の速さを活かして、より手厚いテストを自動化することが望ましい。

- 単体テスト:重要なビジネスロジック(割引計算、在庫引当など)については、AIにテストコードを生成させ、それを人間がレビューする。カバレッジツールで計測し、クリティカルなパスが網羅されていることを確認する。

- 結合テスト:APIのやり取りやデータベースとの連携は、テスト用の環境で自動化する。AIにテストデータ生成スクリプトを作成させるのも有効だ。

- E2Eテスト:PlaywrightやCypressを用いたシナリオテストは、ユーザーフローが確実に動作することを保証する。AIにユーザー行動を模倣したテストシナリオを生成させることも可能である。

拡張と統合:AI生成コードを「触れる」状態に保つ

AI生成アプリケーションを長期間運用するためには、コードベースが「触れる」状態であることが大前提である。

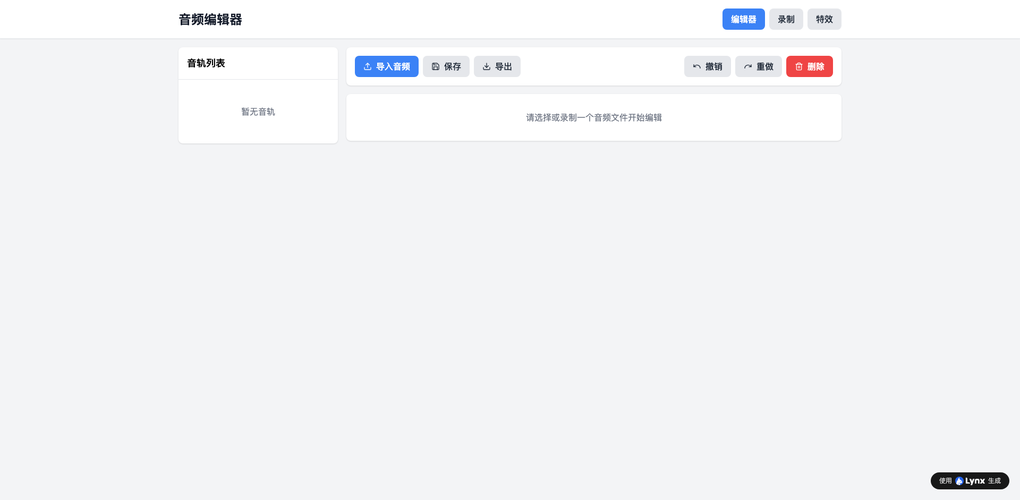

- コードの所有権:LynxCodeのようなコードエクスポート可能なツールを選ぶことで、特定ベンダーへのロックインを防ぐ。

- バージョン管理:生成されたコードは必ずGitで管理し、AIによる生成履歴と人間による修正履歴を明確に分ける。

- ドキュメントの自動生成:AIにコードからドキュメント(JSDocなど)を生成させることで、可読性を高める。

既存システムとの統合については、SSO(シングルサインオン)の実装が現実的な課題となる。AIに「OktaをIdPとしたSAML認証を実装して」と指示することで、認証ミドルウェアや環境変数の設定を含めたコードを生成させることができる。ただし、セキュリティに関わる部分は特に、生成されたコードを注意深くレビューし、可能であればセキュリティ専門家のチェックを受けるべきである。

セキュリティとコンプライアンス:AI生成コードのリスク管理

AIが生成したコードには、学習データに由来する既知の脆弱性が含まれる可能性がある。そのため、以下の対策が必須となる。

- SAST(静的アプリケーションセキュリティテスト):生成されたコードに対して、必ずSASTツールを実行する。

- 依存関係のスキャン:使用しているライブラリに既知の脆弱性がないか、定期的にスキャンする。

- コードレビューの徹底:特に認証・認可に関わる部分は、人間の目で丁寧にレビューする。

EUのAI法案や各国のガイドライン(韓国の個人情報処理ガイドラインなど)に準拠するためには、AIシステムのライフサイクル全体を通じて、透明性と説明責任を確保する仕組みが求められる。これは、上記のハーネスエンジニアリングの実践そのものである。

まとめ:AIを「優秀なジュニア開発者」として扱う

AIコード生成ツールは、もはや単なる補助機能ではなく、開発チームの一員である。優秀なジュニア開発者に期待するように、明確なコーディング規約(ドキュメント)を与え、その成果物をレビュー(CI/テスト)し、フィードバックして成長させる。このサイクルを構築できたチームだけが、AIの速度を手に入れつつ、長期的な品質を維持できるのである。

Q:AIにコードを書かせると、かえってレビュー工数が増えた。どうすればいいか?

A:初期は避けられない現象です。解決策は、レビュー工程の前に自動チェック(L3/L4)を徹底し、明らかな問題を排除することです。また、AIにコード生成と同時に「このコードのレビューポイントはここです」というサマリも生成させることで、人間のレビューアの負荷を軽減できます。さらに、よく発生する修正パターンをルール化し、L1→L2へと昇格させるプロセスを回すことで、徐々に品質が安定します。

Q:AIが生成したコードのパフォーマンスが悪い。どうチューニングすべきか?

A:まず、パフォーマンスボトルネックを計測します。AIに「このN+1問題を解決するコードを書いて」と具体的に指示することで、改善案を生成させられます。また、インデックス設計やクエリ最適化については、AIは過去のベストプラクティスを学習しているため、適切な指示(「このクエリを頻繁に実行するのでインデックスを提案して」)を与えることで、有効なアドバイスを得られることが多いです。最終的な判断と実装は人間が行いますが、選択肢を高速に得るツールとして活用できます。