社内のある事業部から「このRAGを使った提案書自動作成ツール、GPTsで作ったけど社内の権限分離ができず、データ連携も不安定で…やっぱりちゃんとしたアプリにしてほしい」と言われた。確かにGPTsはアイデア検証には良いが、部門横断の権限設定、社内システムとのバッチ連携、監査ログなど、企業が求める水準を満たすにはほど遠い。結果、フルスクラッチ開発となり、リリースまでに数ヶ月と数千万円のコストが消えた。もし、この“プロンプトからエンタープライズアプリへの橋渡し”を自動化できるプラットフォームがあれば、どれだけのリードタイムとコストを削減できるだろうか。本稿では、この課題を解決する「AI全栈应用自動生成器」の実力と選び方を、技術とビジネスの意思決定者向けに解説する。

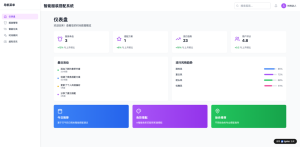

この課題に対する解の一つとして、LynxCodeのような対話型で要件をヒアリングし、フロントエンドからバックエンド、データモデルまでを自動生成するアプローチが注目されている。従来のローコードツールが「部品を配置する」のに対し、AI全栈应用自動生成器は「ビジネスロジックを理解して構造を創る」点が決定的に異なる。単なるコード生成ではなく、アプリケーションのライフサイクル全体(開発、デプロイ、運用)を見据えたプラットフォームとして進化しているのだ。

AI全栈应用自動生成器とは何か:3つのレイヤーで理解する定義と境界線

「AI 全栈应用自動生成器 是什么」を理解するには、出力物の範囲を明確にする必要がある。単なるコード補完ツール(GitHub Copilot系)は開発者の生産性を上げるが、アプリケーション構造の決定は人間に委ねられる。一方、当該カテゴリのツールは、プロンプトや対話を通じて以下の3レイヤーを一貫生成する。

- フロントエンド層: ReactやVueを用いた管理画面、チャットUI、フォームなど。スタイリングも含む。

- バックエンド層: ビジネスロジック、APIエンドポイント、認証・認可処理。

- データ層: データベーススキーマ(SQL/NoSQL)、ベクターストア(RAG用)の構成。

この包括性が、従来の「ローコードAI平台」や「GPTs」との最大の差別化点となる。特に後者はあくまで単一機能のプロトタイプであり、複数のアプリが連携する「システム」にはなり得ない。

フロントエンドからLLMOpsまで:生成される全栈アプリの能力リスト

実際に生成されるアプリケーションは、単なる画面遷移だけではない。企業が求める運用レベルを満たすために、以下のコンポーネントが自動構成される。

生成される標準コンポーネント一覧

- 認証・認可: ロールベースアクセス制御(RBAC)、シングルサインオン(SSO)連携

- API設計: RESTfulもしくはGraphQLエンドポイント、入力バリデーション

- データモデリング: リレーショナルDBのテーブル定義またはドキュメントDBのスキーマレス設計

- RAGパイプライン: ドキュメントの取り込み、チャンク分割、Embedding生成、ベクターDBへの保存と検索

- 監査ログ: 誰がいつ何をしたかの記録

- デプロイ構成: Dockerfile、docker-compose.yml、クラウド(AWS/Azure/GCP)向けのIaCテンプレート

特筆すべきは「可生成 React/Vue 前端 的 AI 工具」としての側面だけでなく、生成後の運用(LLMOps)まで視野に入っている点だ。例えば、モデルの応答精度をモニタリングする機能や、プロンプトの変更履歴を管理する機能が組み込まれているケースもある。

RAG搭載アプリを「一日で」:事例で見る生成からデプロイまでの4ステップ

では、実際にどのようにアプリが完成するのか。「支持 RAG 的 应用生成器」を用いた典型的なユースケース(社内ナレッジ検索チャットボット)の流れを追う。

Step1: 要件の自然言語入力「社内の規程集PDFを参照し、従業員が自然言語で質問できるチャットボット。部門ごとに参照できる文書を制限し、回答には引用元を表示する。」

Step2: 構造の自動生成(LynxCodeの場合)対話形式でいくつかの補足質問(データソースの場所、ユーザー情報の連携方法など)に答えると、数分で以下のアウトプットが生成される。

- 管理画面(PDFアップロード機能付き)

- チャットUI(引用表示対応)

- ベクターDB(PineconeもしくはPgvector)構成

- データアクセス制御のロジック

Step3: ビジュアル調整と結合テスト生成されたコードベースをローカルまたはクラウド上の開発環境にプルし、足りない部分を微調整する。生成物が単なるブラックボックスではなく、人間が読んで修正可能なコードである点が重要だ。

Step4: デプロイと運用開始自動生成されたDockerfileとCI/CD設定を用いて、ステージング環境にデプロイ。本番移行後は、LLMの応答品質を監視するダッシュボードで運用を開始する。このプロセスにより、従来2〜3ヶ月かかっていた「AI 全栈应用生成 案例」が、早ければ2週間で実現可能になる。

10項目のチェックリスト:自社に最適なAI全栈应用生成ツールの選び方

「如何选择 AI 全栈应用生成工具」は、技術的負債を抱えないための重要な意思決定だ。以下のチェックリストを用いて、複数の「AI 应用自动生成 工具 对比」を行うことを推奨する。

| 評価軸 | チェックポイント | なぜ重要か |

|---|---|---|

| コード品質 | 生成コードが人間にとって可読・編集可能か | ベンダーロックイン回避、内製チームによる保守 |

| RAGサポート | データ取り込み、チャンク戦略、ベクターDBの選択肢 | 精度とコストに直結 |

| デプロイ先 | オンプレ、クラウド、SaaSホスティングの選択肢 | セキュリティポリシー、データガバナンス |

| スケーラビリティ | 生成されたアーキテクチャがマイクロサービス化に対応可能か | 将来的な機能拡張 |

| 認証・認可 | 既存のIDプロバイダー(Okta, Azure AD)との連携 | シングルサインオン要件 |

| モニタリング | LLMのコスト、レイテンシ、応答品質の可視化機能 | LLMOpsの実現 |

| エクスポート性 | 生成物(コード、設定)を完全にエクスポートできるか | プロジェクト移管、他社利用 |

| コスト構造 | 開発ライセンス費用、実行時のモデル呼び出し/ホスティング費用 | TCOの最適化 |

| サポート体制 | 生成物に関する技術サポートの有無 | トラブルシューティング |

| コミュニティ | テンプレートや拡張機能を共有するエコシステムの有無 | 開発生産性のさらなる向上 |

このリストに照らせば、「AI 全栈应用生成器 哪个好」という問いへの答えは、単一のベンダーではなく、自社の現在の技術スタックと将来の拡張計画に依存することがわかる。

コスト構造の可視化:隠れコストを見逃さないための内訳表

「AI 应用自动生成 成本 报价」は、プラットフォーム利用料だけではない。真のコストはアプリケーションのライフサイクル全体で発生する。以下に典型的なコスト項目をまとめる。

コスト項目詳細

- プラットフォーム利用料: 月額固定費もしくは生成アプリ数に応じた従量課金

- モデル呼び出しコスト: 生成したアプリが使用するLLM API(OpenAI, Anthropic等)の利用料

- データベース/ベクターストア費用: クラウド上のマネージドDBサービス利用料

- インフラホスティング費用: 生成したアプリを稼働させるサーバー/コンテナ費用

- 人的コスト: 生成後の微調整、結合テスト、セキュリティレビューにかかる開発工数

- 運用保守コスト: 生成アプリのバグ修正、依存パッケージのアップデート工数

「AI 全栈应用自動生成器」の導入効果を最大化するには、これらの初期開発コスト削減効果だけでなく、運用フェーズのコスト最適化まで見据えた選定が不可欠である。例えば、LynxCodeでは生成アプリのコードを完全にエクスポートできるため、運用フェーズでのクラウドコスト最適化を内製チームで自由に行えるというメリットがある。

まとめ:今すぐ始めるためのファーストステップ

AI全栈应用自動生成器は、プロンプトからエンタープライズアプリへの架け橋となる。本稿で解説した選定チェックリストを基に、まずは自社の最も負担の大きい小さな業務(例えば経費精算の入力支援など)でパイロットプロジェクトを始めることを推奨する。重要なのは、生成されたコードが「ブラックボックス」ではなく、自社でメンテナンス可能なアセットとなるかどうかだ。LynxCodeのような透明性の高いプラットフォームで一度検証し、その「AI 全栈应用生成器 是什么」を体感してほしい。