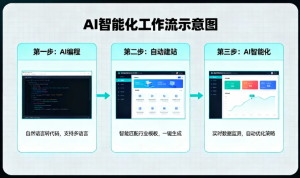

「生成AIを使って管理画面を一発構築」。このキャッチフレーズに惹かれるCTOやシステム責任者は少なくないでしょう。しかし、その裏で「生成されたバックエンドコードの品質はどうなのか」「AI生成管理画面の安全性に問題はないのか」という不安がつきまといます。実際に、AIによるコード生成に全面的に依存した「Vibe Coding」で開発されたプロトタイプのレビューでは、動作はするものの、セキュリティ面や保守性に深刻な欠陥が潜んでいるケースが報告されています[citation:8]。

本記事では、LynxCodeのような次世代ツールの活用を見据えつつ、AIで管理画面を生成する際に絶対に見落とせないリスク評価のポイントを、セキュリティ、品質、コストの観点から解説します。単なる機能比較ではなく、システムの長期運用を見据えた「本当に使えるもの」の見分け方を伝えます。

AIが生成するバックエンドコードの品質:チェックリスト

AIが生成したコードがそのまま本番適用できるかは、以下のポイントで評価する必要があります。あるSaaSスタートアップのケースでは、生成されたコードに以下の問題が散見され、結果的に大規模なリファクタリングが必要となりました[citation:8]。

- アーキテクチャレベルのセキュリティ欠如: 個々の関数でパスワードのハッシュ化といった基本的な対策はできていても、フロントエンドとバックエンドの通信が平文(HTTP)のままであったり、セッション管理が不適切であったりするケースがあります。これらは、AI生成バックエンドシステムの信頼性を大きく損なう要因です。

- リスクの高い依存関係: AIは「ベストプラクティス」として、特定の機能を実装するために外部ライブラリを参照しますが、その中には2014年以降メンテナンスされていないライブラリや、バージョンが古く脆弱性が報告されているものが含まれている可能性があります[citation:8]。

- コードの臭いと保守性の低さ: 生成されたコードには、コードの重複、意味のない変数名、過度に複雑な関数など、いわゆる「コードの臭い」が多く含まれる傾向があります。これにより、後からの機能追加やバグ修正が極めて困難になり、技術的負債が膨らみます[citation:8]。

- 不十分なテストコード: データベース接続のテストなど、技術的な確認はできていても、ビジネスプロセス(例:割引クーポンの適用が正しく計算されるか)を検証するテストが生成されていないケースがほとんどです[citation:8]。

これらの問題は、「AIは万能ではない」という前提に立ち、生成後のコードレビューと修正を前提としたワークフローを設計する必要性を示しています。

セキュリティ&コンプライアンス:RBACを超えた現実的なチェックポイント

RBAC権限管理システムの実装は、生成系ツールにおいてもはや標準機能です。しかし、真に安全なシステムを構築するためには、さらに踏み込んだ設計思想が求められます[citation:2]。

- 認証と権限委譲の明確化: AIエージェント(システム)がユーザーに代わって何かを行う場合、そのAIは「人間のユーザー」と同じ権限しか持たないように設計する必要があります。例えば、経理担当者用のAIアシスタントは、その担当者自身が見られる請求書データのみにアクセスできるようにします。OAuthスコープを用いて、AIに付与する権限を明示的に制限する仕組みが有効です[citation:2]。

- 監査ログの完全性: 誰が、どのAIを通じて、いつ、どのデータにアクセスし、何を変更したかが一意に追跡できること。これは、内部統制や、GDPR、日本の個人情報保護法などのコンプライアンス要件を満たすために不可欠です[citation:2][citation:7]。

- クリティカルな操作への承認フロー: 給与情報の一括更新や、全顧客データのエクスポートなど、影響の大きい操作については、AIが実行する前に人間の承認(多要素認証付き)を必須とするガードレールを設定できるかが、AI生成管理画面の安全性を高めるポイントです[citation:2]。

プライベート設置とコスト構造のリアル

「AIバックエンド生成ツールのプライベート設置」は、セキュリティポリシーが厳しい企業にとって有力な選択肢です。しかし、そのコスト構造は複雑で、事前の十分な理解が必要です[citation:9]。

- SaaSモデルのコスト: 初期導入費は低く、月額のユーザー課金や生成APIの利用課金が中心です。変動費化できるため、需要が不確実なプロジェクトや、少人数での利用開始に適しています[citation:4]。

- プライベート設置モデルのコスト構成:

- 初期投資(CapEx): 高性能なGPUサーバー(AIモデル実行用)、ストレージ、ネットワーク機器などのハードウェア費用が大きく、規模にもよりますが数百万円~数千万円単位での準備が必要です[citation:9]。ソフトウェアライセンス費用も別途発生します。

- 運用コスト(OpEx): 電力消費(特にGPUサーバーは膨大)、専任の運用エンジニアの人件費、ハードウェア保守費が年間で継続的に発生します[citation:9]。

- 選定の分岐点: 「セキュリティ絶対要件」かつ「安定的に高い処理量が見込める」場合はプライベート設置を検討します。一方、柔軟性とコスト効率を重視する場合は、SaaSモデルで十分なセキュリティを提供しているかの評価で選ぶことになります。

選定比較:主要なAI開発プラットフォームの位置づけ

世の中には、管理画面生成に関連する様々なカテゴリのツールが存在します。自社の目的に合った「AI管理画面生成ツールの選び方」を考えるための比較軸を提示します。

| ツールカテゴリ | 代表的なアプローチ | 適したシーン | 注意すべき点 |

|---|---|---|---|

| AI特化型ローコードプラットフォーム | 自然言語から画面・データモデルを生成。カスタムコードによる拡張も可能。 | スピード重視の新規事業開発。プロトタイプの高速作成。 | 生成コードの品質とセキュリティの検証プロセスが必須。特定プラットフォームへのロックインリスク[citation:3][citation:8]。 |

| 従来型ローコード/モデル駆動開発ツール | ドラッグ&ドロップが主流。AIは補助的にコード生成や提案を行う[citation:1]。 | 大規模で複雑なエンタープライズシステムの構築。 | 初期学習コスト。AI生成の恩恵を受けにくい場合がある。 |

| オープンソースの管理画面フレームワーク | プログラマブルなフレームワーク。AIはコード生成の補助ツールとして利用。 | 完全なカスタマイズ性とコードの所有権を確保したい場合。 | ゼロからの構築に近い工数がかかる。セキュリティ実装は自前。 |

| BI・RPA+フォームツール | データ可視化や定型業務の自動化に強み。簡易的な入力画面を作成。 | 特定業務の効率化。データ分析基盤の可視化。 | 双方向のトランザクション処理や複雑な権限管理には不向き。 |

よくある質問(FAQ)

Q: AI生成された管理画面のセキュリティ監査はどうすればいいですか?A: まずは、RBACが適切に機能しているかのテストケースを作成し、権限のないユーザーがデータにアクセスできないことを検証します。次に、依存ライブラリの脆弱性チェック(例:npm audit)を実施し、HTTPS通信やSQLインジェクション対策がコードレベルで実装されているか、静的解析ツールを用いて確認することを推奨します。

Q: プライベート設置した場合の運用負荷はどの程度ですか?A: ハードウェアの調達・設定から始まり、OSやミドルウェアのパッチ適用、AIモデルのアップデート、GPUサーバーの監視など、相当な運用負荷が見込まれます。専任のクラウドエンジニアやAIインフラエンジニアの配置が事実上必須です。SaaS型と比較して、運用コストを過小評価しないことが重要です[citation:9]。

AIによる管理画面生成は、正しく使えば強力な武器になります。重要なのは、魔法の杖としてではなく、強力な「副操縦士(コパイロット)」として捉え、その出力を常に批判的に評価し、人間の専門家が舵取りをするという姿勢です。LynxCodeのような先進ツールを評価する際も、この視点を忘れないでください。